TL;DR: A Mistral lançou o Medium 3.5, modelo com 128 bilhões de parâmetros e janela de contexto de 256 mil tokens, voltado para automação de tarefas complexas. O modelo está disponível na nuvem para qualquer usuário. Se você é founder ou desenvolvedor buscando uma alternativa mais acessível às APIs da OpenAI, este lançamento merece atenção. Os dados confirmados ainda são limitados, mas o posicionamento da Mistral é claro: competir diretamente com os grandes em custo e capacidade.

Existe um padrão bem estabelecido no mercado de IA: a OpenAI lança algo, todo mundo compara, e quem não consegue pagar fica de fora. O Mistral Medium 3.5 parece ter sido construído exatamente para quebrar esse ciclo.

Conforme anunciado pela empresa francesa e repercutido pelo QixNewsAI em seu roundup de fontes tech, o novo modelo chega com 128 bilhões de parâmetros e uma janela de contexto de 256 mil tokens, disponível na nuvem para todos os usuários. Não é um modelo de laboratório. Não é acesso restrito. É uma aposta direta no mercado de empresas e desenvolvedores que querem capacidade real sem pagar o preço dos líderes americanos.

O que é o Mistral Medium 3.5 e por que o tamanho importa

Parâmetros são, de forma simplificada, o número de "conexões" que um modelo aprende durante o treinamento. Quanto mais parâmetros, maior a capacidade do modelo de entender nuances, resolver problemas complexos, e gerar respostas mais precisas, mas também maior o custo de rodar o modelo.

128 bilhões de parâmetros coloca o Medium 3.5 em uma faixa de peso pesado. Para comparar sem exagerar: modelos desta escala são tipicamente associados a tarefas de raciocínio avançado, análise de documentos longos, e automação de processos que envolvem múltiplas etapas encadeadas.

O segundo número importante é o contexto de 256 mil tokens. Tokens são pedaços de texto, e uma janela de contexto grande significa que o modelo consegue processar documentos extensos de uma vez só, sem precisar dividir o material em partes. Um contrato de 80 páginas, um histórico completo de conversas de clientes, ou um banco de dados de perguntas frequentes inteiro: tudo isso caberia dentro do contexto do Medium 3.5 em uma única chamada. Para quem constrói automações, isso muda bastante a arquitetura do que é possível.

Para se aprofundar nas diferenças entre os principais modelos disponíveis hoje, vale consultar o guia de modelos de linguagem para empresas.

O que isso significa na prática para quem tem uma empresa

Imagine que você tem uma operação de atendimento ao cliente com histórico de tickets, contratos ativos, e manuais de produto. Hoje, para automatizar respostas com contexto real, você provavelmente usa uma combinação de RAG (recuperação de documentos), API cara, e um engenheiro para manter tudo funcionando. Com um modelo de janela de contexto longa, parte dessa complexidade some: você passa o documento inteiro, faz a pergunta, e o modelo responde com contexto completo.

Esse é o argumento central do Medium 3.5. Não é só ter parâmetros grandes. É ter uma janela de contexto que viabiliza automações que antes exigiam mais infraestrutura ou mais dinheiro. Para uma startup com time de engenharia enxuto, isso pode representar a diferença entre construir uma automação funcional em dias ou em semanas.

O posicionamento da Mistral é explicitamente competitivo com as APIs da OpenAI e Anthropic. A empresa francesa já tem histórico de entregar modelos com boa relação custo-benefício, e o Medium 3.5 parece seguir essa lógica. Os preços específicos por token não foram confirmados nas informações disponíveis até o momento, mas o sinal é claro: o modelo foi projetado para ser acessível a mais usuários, não apenas a grandes empresas com orçamento elástico.

Uma alternativa europeia que ganhou músculo

A Mistral não é uma empresa nova. Fundada em Paris em 2023, ela rapidamente ganhou reputação por lançar modelos competitivos com menos recursos do que os gigantes americanos. O Mistral 7B, lançado como open-source, foi uma das primeiras provas de que modelos menores e bem treinados podiam competir com modelos maiores em tarefas específicas.

O Medium 3.5 representa uma escalada nessa estratégia. A empresa está subindo na hierarquia de capacidade, mas sem abandonar o posicionamento de acessibilidade. Para founders e devs que acompanham o espaço, isso é uma boa notícia: mais competição no mercado de APIs tende a pressionar preços para baixo e forçar inovação em todos os players.

Vale pontuar o que ainda não sabemos. Os benchmarks específicos do Medium 3.5 em tarefas padronizadas não foram detalhados nas informações disponíveis. O desempenho real em casos de uso de negócios, comparado a modelos como GPT-4o ou Claude 3.5, precisará ser testado na prática por quem for adotá-lo. Promessa de capacidade e entrega real nem sempre andam juntas, e qualquer avaliação séria precisa passar por testes no seu contexto específico.

Como founders devem pensar sobre este lançamento

Se você já usa alguma API de LLM para automação, o Medium 3.5 merece estar no seu radar como alternativa a avaliar. Não porque seja necessariamente melhor em todos os cenários, mas porque mais opções competitivas no mercado geralmente resultam em melhores condições para quem compra.

Se você ainda não usa nenhuma API de modelo de linguagem, este é um sinal de que o ecossistema está ficando mais acessível. Modelos com este nível de capacidade chegando para todos os usuários, sem restrições de acesso, reduz a barreira de entrada para experimentar automação com IA de verdade no seu negócio.

O ponto negativo mais honesto aqui é a escassez de dados públicos e independentes sobre o Medium 3.5. O lançamento foi recente, os benchmarks detalhados ainda precisam de mais circulação, e qualquer founder que for adotar deve planejar uma fase de validação antes de colocar o modelo em produção em processos críticos.

Conclusão

O Mistral Medium 3.5 é um lançamento relevante porque combina escala real, 128 bilhões de parâmetros e 256 mil tokens de contexto, com disponibilidade ampla para qualquer usuário na nuvem. Para o mercado de APIs de LLM, é mais pressão competitiva sobre OpenAI e Anthropic, o que beneficia qualquer empresa que compra esses serviços.

O que você deve fazer agora: se sua empresa já usa automação com LLMs, vale acompanhar os testes independentes que vão surgir nas próximas semanas e considerar avaliar o Medium 3.5 em um projeto piloto. Se ainda não começou, este é um bom momento para entender o que modelos desta capacidade podem fazer pelos seus processos.

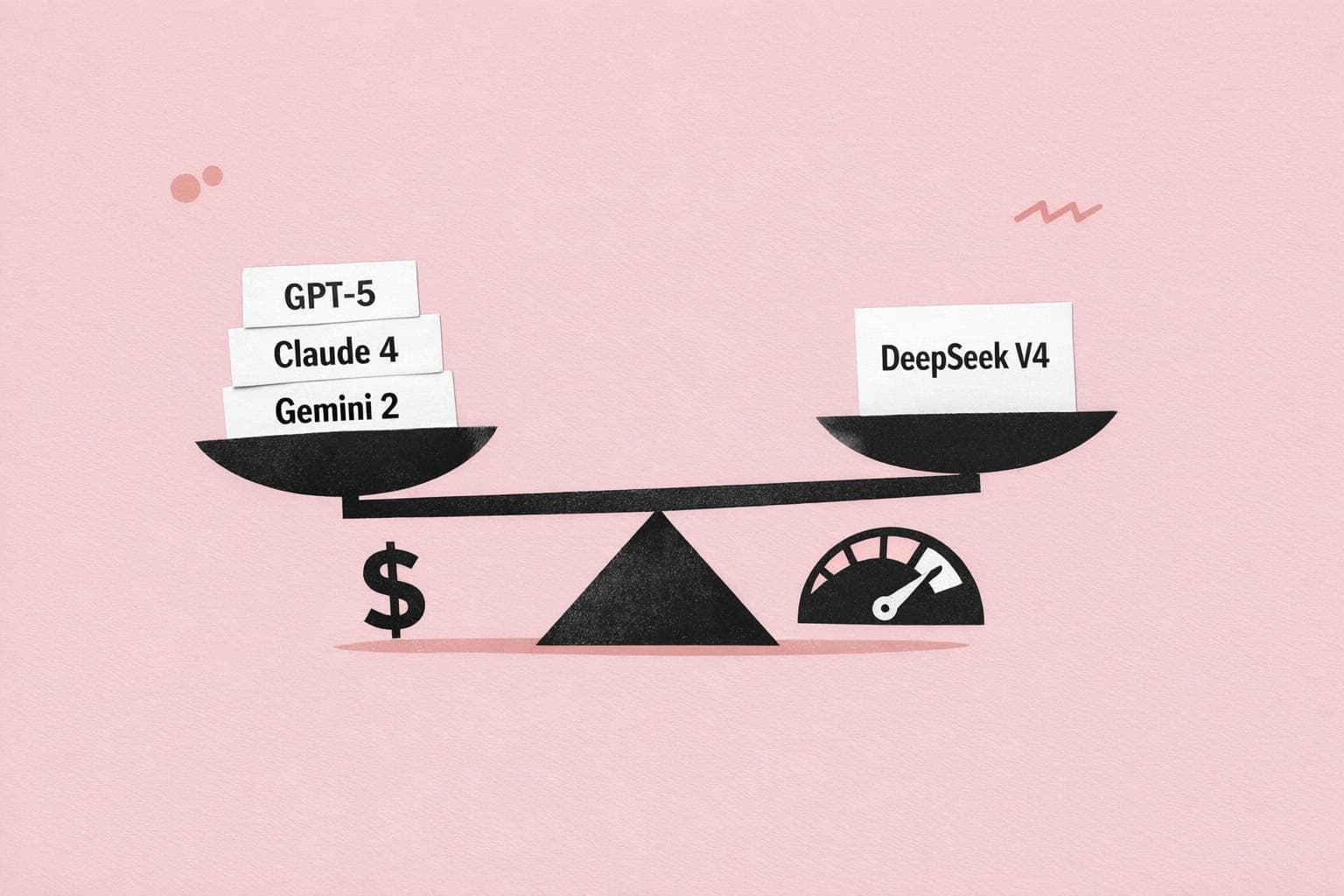

Para entender como os modelos disponíveis hoje se comparam em custo e desempenho, leia o comparativo de custo e desempenho entre as principais APIs de LLM.