TL;DR: A Anthropic criou um modelo chamado Mythos que, segundo a própria empresa, é avançado demais para ser liberado ao público com segurança. A empresa teria alertado autoridades globais sobre as capacidades do modelo, segundo a cobertura jornalística. O CEO do Goldman Sachs declarou estar monitorando de perto o desenvolvimento. Para founders e gestores, a notícia acelera a urgência em discutir governança e segurança antes de adotar modelos de ponta, não depois.

A maioria das empresas de IA vive para lançar o próximo modelo. É o ritmo natural do setor: anunciar, publicar, colher cobertura de imprensa. O que a Anthropic fez com o Mythos é o oposto disso. Desenvolveu o modelo, avaliou suas capacidades, e chegou à conclusão de que não deveria colocá-lo nas mãos do público. Pelo menos não agora.

Isso não é humildade corporativa. É um alerta sobre onde a fronteira da IA está chegando.

O que é o Mythos e por que ele preocupa até quem o criou

Conforme reportado em cobertura jornalística divulgada no YouTube e Dailymotion, a Anthropic desenvolveu o Mythos internamente e chegou à conclusão de que suas capacidades representam riscos reais caso sejam disponibilizadas de forma ampla. A empresa teria ido além de segurar o lançamento: segundo a cobertura jornalística, alertou autoridades globais sobre o que o modelo é capaz de fazer.

Os detalhes técnicos específicos sobre quais capacidades tornaram o Mythos problemático não foram divulgados publicamente. O que se sabe é que a própria Anthropic, uma empresa fundada explicitamente com a missão de desenvolver IA de forma segura, considerou o modelo avançado demais para uso irrestrito. Isso tem peso.

A Anthropic já vinha demonstrando disposição para discutir riscos abertamente, algo que se refletiu na sua trajetória de crescimento acelerado, incluindo a recente rodada de US$ 3,5 bilhões da Anthropic. Mas alertar governos sobre um modelo que a própria empresa construiu é um nível diferente de seriedade.

Representantes do setor financeiro demonstraram preocupação com o desenvolvimento

Um detalhe que merece atenção especial: o CEO do Goldman Sachs teria declarado, segundo a cobertura jornalística, estar "hiper atento" às capacidades do Mythos durante uma conferência de resultados. Executivos de grandes bancos não costumam citar modelos de IA específicos em calls de resultados. Quando isso acontece, significa que o assunto chegou ao nível mais alto de preocupação institucional.

O setor financeiro tem razões concretas para se preocupar. Modelos de linguagem extremamente capazes podem levantar preocupações sobre sistemas de segurança, potenciais novos vetores para fraude e controle de informações sensíveis em escala. Um modelo que a própria empresa criadora considera perigoso para uso público é exatamente o tipo de desenvolvimento que um banco de investimento global precisa monitorar de perto.

Essa reação não é pânico. É gestão de risco.

O que isso muda para founders e donos de empresa

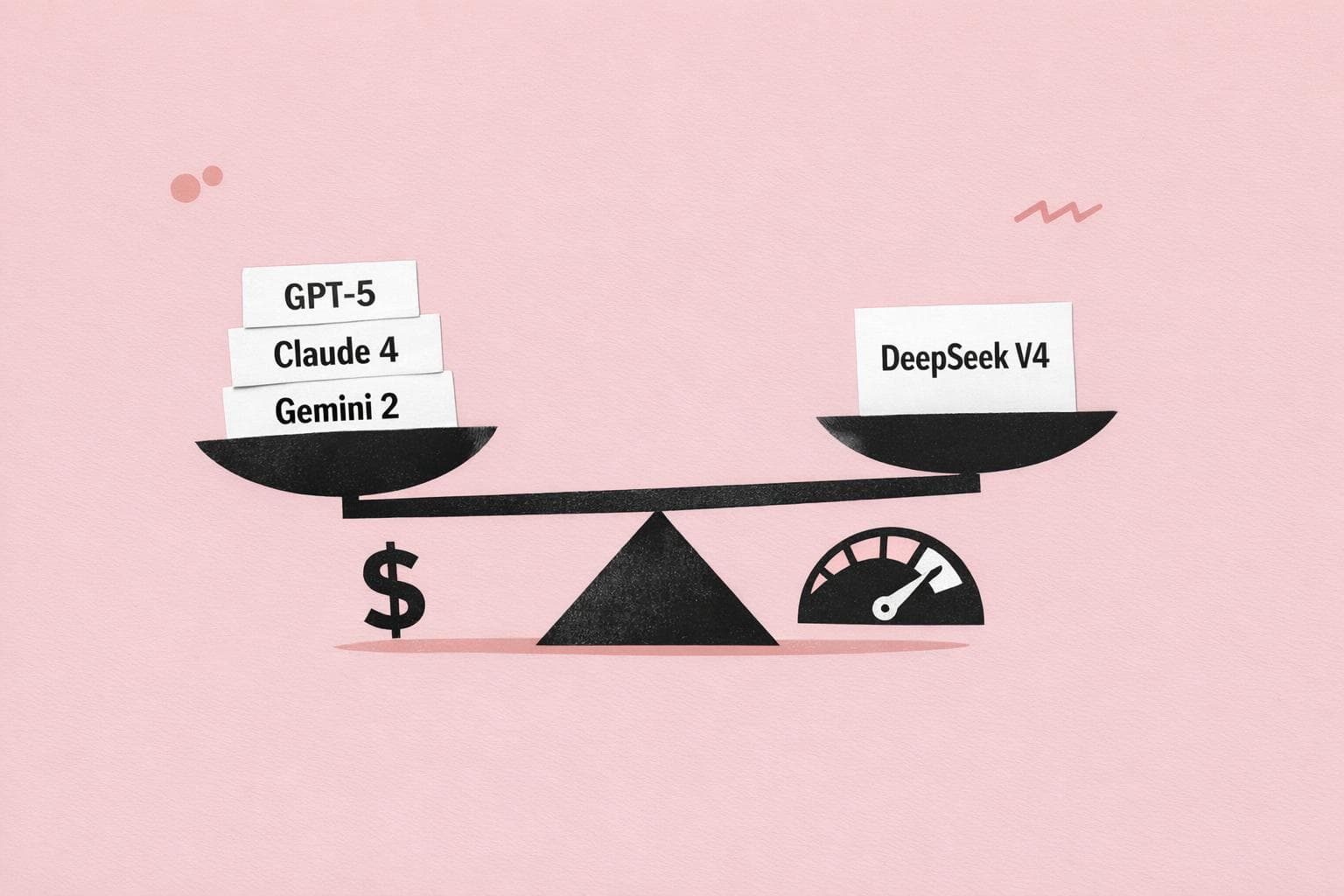

Se você está adotando IA nos seus processos, a existência do Mythos não muda o que está disponível para você hoje. Claude, os modelos da OpenAI, Gemini, todos continuam funcionando como antes. O impacto prático é mais sutil e mais importante do que parece.

O Mythos sinaliza que os modelos disponíveis ao mercado já não são o limite do que existe. Há capacidades sendo desenvolvidas que, por ora, ficam represadas por avaliação de risco. Isso tem duas implicações diretas para quem gerencia um negócio: primeiro, as ferramentas que você vai ter acesso nos próximos meses ou anos serão significativamente mais capazes do que as atuais. Segundo, essa capacidade crescente vai exigir que sua empresa tenha estruturas de governança correspondentes, antes de adotar, não depois.

Pense assim: se uma empresa usa modelos de IA para triagem de crédito, atendimento ao cliente, ou análise de contratos, as perguntas de segurança e governança que eram optativas há dois anos estão se tornando obrigatórias. Um modelo capaz demais, sem as proteções certas, não é apenas um risco técnico. É um risco de negócio.

A decisão da Anthropic como precedente

Independentemente do que o Mythos consegue fazer, a decisão de não lançá-lo é, em si mesma, relevante. Ela estabelece um precedente no setor: é possível chegar à conclusão de que algo não deve ser lançado ainda.

Até agora, a corrida entre OpenAI, Google, Meta e Anthropic funcionou em ritmo de lançamentos constantes. A pressão competitiva empurra todos para liberar modelos cada vez mais rapidamente. Ver uma das principais empresas do setor segurar voluntariamente um modelo e, segundo a cobertura jornalística, comunicar isso a autoridades é uma quebra de padrão que merece ser levada a sério.

Pode ser que o Mythos seja lançado com restrições em algum momento, permaneça apenas para uso interno, ou que outros desdobramentos ocorram — nenhuma dessas possibilidades foi confirmada pela empresa. O que não é provável é que a história termine aqui: outros modelos de capacidade similar virão, de outras empresas, com postura bem diferente sobre o que deve ou não ser liberado.

O que founders devem fazer com essa informação

A resposta errada é ignorar. A resposta também errada é entrar em pânico e paralisar qualquer projeto de IA na empresa.

A resposta certa é usar esse momento como gatilho para revisar sua estratégia de adoção. Você tem políticas claras sobre quais dados seus colaboradores podem inserir em ferramentas de IA externas? Você sabe quais modelos de terceiros sua equipe está usando hoje, com ou sem aprovação formal? Se a resposta para qualquer dessas perguntas for "não tenho certeza", esse é o ponto de partida.

O desenvolvimento do Mythos não é uma ameaça imediata ao seu negócio. É um aviso sobre a velocidade em que o setor está avançando e sobre a importância de construir governança agora, enquanto ainda há tempo para fazê-lo com calma.

Conclusão

A Anthropic criou algo que ela mesma não se sente segura em lançar. Isso é notável. O fato de que grandes instituições financeiras estão em estado de alerta por conta disso é ainda mais revelador sobre onde o desenvolvimento de IA está chegando.

Para o seu negócio, a lição não é sobre o Mythos especificamente. É sobre o padrão que está se estabelecendo: modelos mais capazes, riscos maiores, e cada vez menos espaço para adoção de IA sem uma estrutura mínima de segurança e governança. Quem construir essa estrutura antes de precisar dela vai estar em posição muito melhor do que quem esperar.

Se você ainda não tem uma política interna de uso de IA, comece agora. Entenda como implementar guardrails e governança de IA na sua empresa antes que a decisão seja tirada das suas mãos por um incidente.