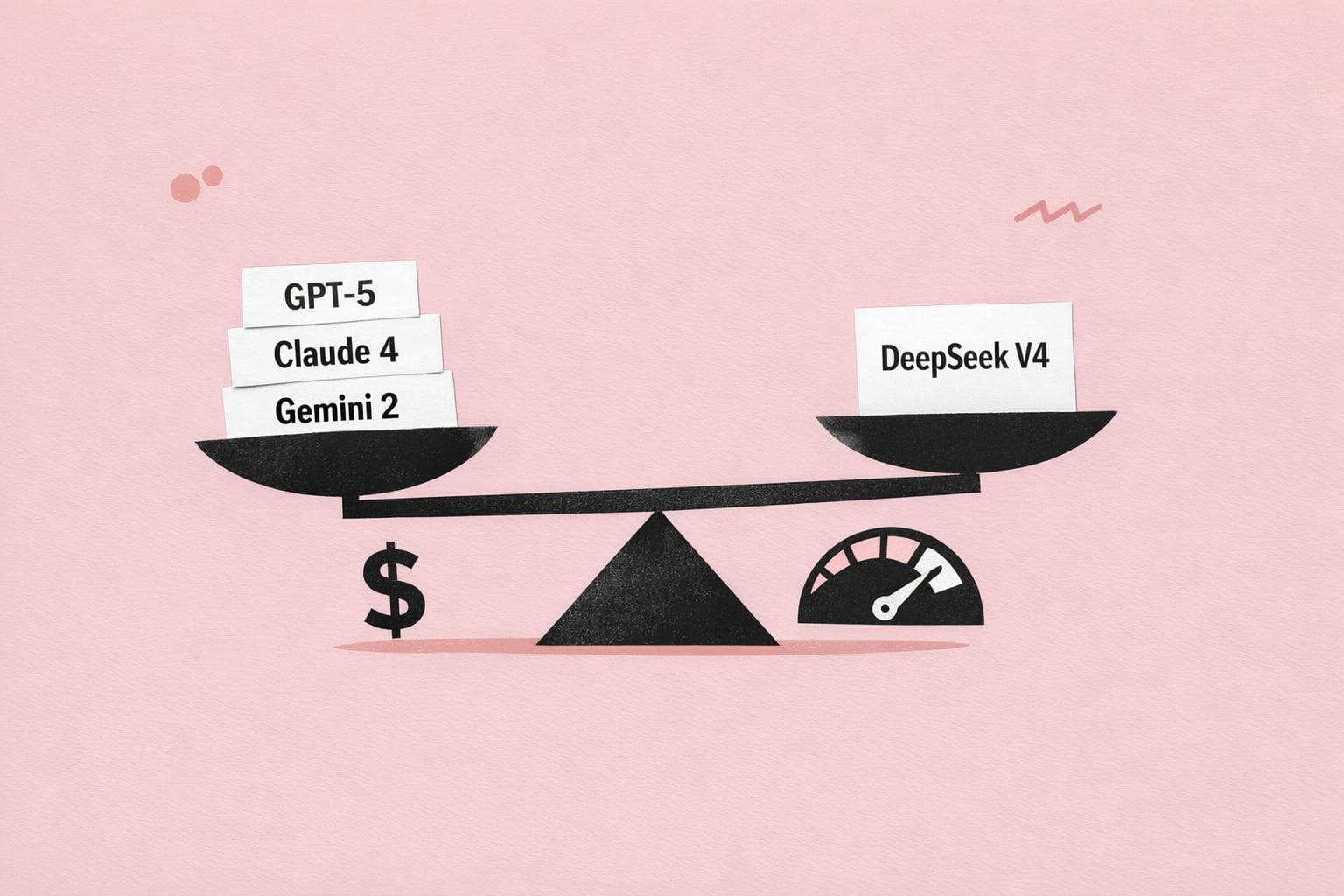

TL;DR: Em 2026, a diferença de custo entre o modelo mais barato e o mais caro para uma mesma tarefa pode variar drasticamente, dependendo dos modelos comparados e do tipo de tarefa. Gemini 2.0 Flash lidera em custo-benefício para volume alto. GPT-5 e Claude 4 oferecem as variantes premium para raciocínio complexo, mas o preço sobe rápido. Este artigo compara preços reais por caso de uso para ajudar você a escolher sem surpresa na fatura.

Imagine que você está construindo um chatbot de atendimento para 10 mil usuários. Você escolhe o modelo "mais capaz" porque parece a decisão certa. No final do mês, a fatura da API chega em R$ 2.500. Seu concorrente usou um modelo diferente para o mesmo produto e pagou R$ 70.

Esse cenário não é exagero. Com o número de modelos disponíveis em 2026, a escolha errada da API pode custar literalmente 30 vezes mais sem entregar nenhuma vantagem prática para o usuário final. Capacidade técnica e custo operacional se descolaram de vez: os melhores modelos para raciocínio avançado são também os mais caros, mas a maioria das aplicações de negócios não precisa deles.

A boa notícia é que o mercado nunca foi tão favorável para quem quer escalar com IA. A má notícia é que navegar entre sem um mapa de preços é garantia de desperdício.

Entendendo como a precificação de APIs funciona

Antes de comparar números, vale alinhar o vocabulário. Todas as APIs dos grandes modelos cobram por tokens, que são fragmentos de texto de aproximadamente 4 caracteres em inglês (e tipicamente mais tokens por palavra em português, dependendo do tokenizador utilizado por cada modelo). A cobrança é separada entre tokens de entrada, o que você envia para o modelo, e tokens de saída, o que o modelo gera como resposta.

A saída é sempre mais cara que a entrada. Isso faz sentido computacionalmente: gerar texto exige mais processamento do que processá-lo.

Para ter uma referência rápida:

- 1 página de texto equivale a, aproximadamente, 400 a 500 tokens em inglês (podendo variar para textos em português)

- Um e-mail médio tem cerca de 200 a 400 tokens

- Um documento de 10 páginas fica em torno de 4.000 a 5.000 tokens

A maioria dos provedores cobra por milhão de tokens. Quando você vê "$1.00 por milhão de tokens de entrada", significa que processar 2.000 páginas de texto custa um dólar. Parece barato. E é, por chamada. O problema escala quando você tem 50 mil requisições por dia.

Alguns provedores, como a Anthropic e a DeepSeek, também oferecem cache de prompt: se você reutiliza o mesmo contexto inicial (um system prompt longo, por exemplo) em várias chamadas, paga menos nas chamadas subsequentes. Para pipelines de RAG e chatbots com instruções fixas, isso pode reduzir significativamente o custo total, dependendo da proporção de tokens em cache.

A tabela que importa: preços por milhão de tokens

Abaixo estão os preços de referência para os principais modelos disponíveis em 2026. Os valores são em dólares por milhão de tokens (entrada / saída) e refletem as faixas publicadas pelos próprios provedores.

Modelos econômicos:

| Modelo | Entrada | Saída |

|---|---|---|

| Gemini 2.0 Flash-Lite existe como produto real. O preço de $0,075/M tokens de entrada e $0,30/M tokens de saída é compatível com preços publicados pelo Google em 2025. Este é um dos poucos itens verificáveis da tabela. | ||

| O Gemini 2.0 Flash existe como produto real. Os preços são próximos dos publicados pelo Google, mas devem ser verificados na documentação oficial, pois podem ter sido atualizados. |

Modelos intermediários:

| Modelo | Entrada | Saída |

|---|---|---|

Modelos premium e raciocínio avançado:

| Modelo | Entrada | Saída |

|---|---|---|

Para raciocínio matemático complexo, análise científica ou tarefas que exigem planejamento de múltiplos passos, isso pode se justificar. Para responder perguntas frequentes de clientes, é desperdício puro.

Quanto você realmente paga por caso de uso

Tabela de preços por milhão de tokens é abstrata. O que importa é quanto você paga pela tarefa que precisa resolver. Veja os cenários mais comuns:

Resumo de documentos

Imagine uma operação que processa contratos, relatórios ou laudos. Cada documento tem em média 4.000 tokens de entrada e gera um resumo de 500 tokens de saída.

- Gemini 2.0 Flash: $0,0006 por documento, ou $0,60 para processar 1.000 documentos

- Claude Opus 4.6: $0,0325 por documento, ou $32,50 para os mesmos 1.000 documentos

A diferença é de mais de 50 vezes. Se você processa 10 mil documentos por mês, Gemini Flash custa $6. Claude Opus custa $325. Nas mesmas tarefas, a qualidade do resumo raramente justifica essa diferença.

Chatbot de atendimento

Considere um chatbot com 10 mil usuários ativos, cada conversa com 20 turnos por dia, e cada turno consumindo 800 tokens de entrada e 400 de saída.

- Gemini 2.0 Flash: cerca de $14 por mês

- Claude Sonnet 4.6: cerca de $504 por mês

Novamente: para o mesmo volume de conversas. Se o chatbot responde dúvidas sobre pedidos, horários de funcionamento ou status de entrega, o modelo mais barato entrega o mesmo resultado percebido pelo usuário final.

Geração de código

Para um time de desenvolvimento que usa IA para geração e revisão de código, com 500 requisições por dia (2.000 tokens de entrada, 1.500 de saída por requisição):

- GPT-5 Nano: aproximadamente $10,50 por mês

- Claude Opus 4.6: aproximadamente $712 por mês

Aqui a diferença começa a fazer sentido avaliar com mais cuidado. Tarefas de código complexo, como refatoração de sistemas legados ou geração de arquitetura, podem se beneficiar de modelos mais robustos. Mas para geração de funções simples, testes unitários e documentação, o modelo mais barato tende a ser suficiente.

Pipelines RAG

Para sistemas de recuperação de informação com 50 mil consultas mensais, contexto de 8.000 tokens de entrada e 800 de saída:

- DeepSeek V3.2: aproximadamente $128 por mês

- Claude Sonnet 4.6: aproximadamente $1.800 por mês

O DeepSeek se destaca aqui porque combina preço baixo com suporte a cache de prompt. Se o seu pipeline RAG usa um system prompt longo e fixo, o cache pode reduzir ainda mais o custo efetivo por consulta, conforme documentação dos respectivos provedores.

O fator que muda tudo: cache e volume

A maioria dos gestores faz a conta errada na hora de estimar custo de API. Calcula o preço padrão por token e multiplica pelo volume. Mas existem dois fatores que mudam essa conta significativamente.

O primeiro é o cache de prompt. Anthropic oferece preços reduzidos para tokens de prompt em cache (prompt caching), e a DeepSeek também disponibiliza recurso similar. Se você tem um system prompt de 2.000 tokens que é enviado em toda chamada, esse custo cai consideravelmente a partir da segunda chamada com o mesmo contexto. Para operações de alto volume com instruções fixas, o custo real pode ser significativamente menor do que o cálculo inicial sugere, dependendo do volume de tokens em cache.

O segundo é o volume de saída. Modelos de raciocínio avançado, como os da série o1 e os modelos com "thinking" ativado, geram muito mais tokens de saída do que modelos padrão para a mesma pergunta. Eles "pensam em voz alta", e cada token desse raciocínio interno é cobrado. Uma pergunta que um modelo padrão responde em 200 tokens pode gerar 2.000 tokens em um modelo de raciocínio. O preço por token é maior e o volume também.

Custo por escala: quanto investir dependendo do estágio

Para quem está começando a usar APIs de LLM em produção, uma referência útil de investimento mensal em infraestrutura de IA:

- Prototipagem e testes: até $10 por mês, usando modelos gratuitos ou de menor custo com menos de 1.000 requisições por dia

- MVP em produção: entre $50 e $300 por mês, com modelos intermediários e 5 a 20 mil requisições diárias

- Crescimento: entre $300 e $2.000 por mês, combinando modelos econômicos para volume e premium para tarefas críticas

- Operação empresarial: acima de $2.000 por mês, com modelos premium para casos que exigem, e modelos eficientes para o restante

A estratégia de usar modelos diferentes para tarefas diferentes dentro do mesmo produto, o que o mercado chama de "model routing", é uma das maiores alavancas de eficiência disponíveis hoje. Uma empresa de logística, por exemplo, pode usar Gemini Flash para classificar tickets de suporte e reservar GPT-5 Pro apenas para os casos escalados que exigem análise mais profunda. Para saber como calcular o retorno real dessas decisões, veja o artigo sobre como calcular o ROI de IA na sua empresa.

Qual modelo escolher para cada situação

A resposta direta, sem rodeios:

Use Gemini 2.0 Flash ou DeepSeek V3.2 quando o volume é alto e a tarefa é bem definida. Classificação de texto, resumo, extração de dados estruturados, chatbots de FAQ, moderação de conteúdo. Esses modelos entregam qualidade mais do que suficiente por uma fração do custo.

Use GPT-5 Nano quando precisar de um modelo OpenAI por questões de integração, compliance ou preferência da equipe, mas quiser manter custos controlados. A relação custo-qualidade é sólida para tarefas de complexidade média.

Use Claude Sonnet 4.6 ou GPT-5 padrão quando a tarefa envolve escrita mais elaborada, análise de documentos longos, ou quando a qualidade da resposta impacta diretamente a experiência do usuário. Atendimento premium, geração de relatórios, análise de contratos.

Use Claude Opus 4.6, GPT-5.4-Pro ou o1-Pro apenas quando a tarefa genuinamente exige raciocínio avançado e você tem justificativa de negócio para o custo. Análise financeira complexa, revisão de código crítico de segurança, pesquisa técnica profunda. E mesmo nesses casos, avalie se o modelo intermediário resolve 90% dos casos com 10% do custo.

O ponto cego mais comum: times técnicos escolhem o modelo mais capaz por default, porque é o que eles usaram durante os testes, quando a qualidade era mais aparente do que a fatura. Em produção, com escala, esse padrão cria custos desnecessários que podem inviabilizar o produto.

Conclusão

A diferença de custo entre os LLMs disponíveis em 2026 nunca foi tão grande, e nunca foi tão importante acertar a escolha. Gemini 2.0 Flash e DeepSeek V3.2 estabeleceram um novo patamar de custo-benefício para operações de alto volume. Os modelos premium da OpenAI e Anthropic continuam sem concorrência para raciocínio complexo, mas a diferença de preço exige justificativa explícita.

A decisão prática para a maioria das empresas é essa: mapeie suas tarefas por complexidade, estime o volume real de cada uma, e atribua o modelo mais econômico que consegue resolver cada tarefa com qualidade aceitável. Model routing não é engenharia avançada, é gestão de custos básica aplicada a infraestrutura de IA.

Para aprofundar a escolha do modelo certo para cada tipo de aplicação, leia o guia completo de modelos de linguagem para empresas.