TL;DR: Em 2026, o mercado de modelos de linguagem está dividido entre gigantes como modelos frontier de última geração para tarefas complexas, e modelos menores e eficientes como Phi-3.5 e Mistral Nemo para implantação local. Este guia explica as diferenças práticas, os casos de uso certos para cada modelo e como uma empresa real deveria tomar essa decisão. Não existe "melhor modelo": existe o modelo certo para o seu contexto, orçamento e infraestrutura.

Escolher um modelo de linguagem para a empresa virou uma decisão parecida com escolher um ERP: tem gente demais vendendo o produto certo para todos os casos, e falta um mapa honesto do território.

Em 2024, a pergunta era "devo usar IA?" Em 2026, a pergunta mudou. Agora é: "qual modelo, para qual tarefa, rodando onde, com qual custo?" São perguntas bem diferentes, e a resposta errada custa tempo, dinheiro e credibilidade interna.

Este guia foi construído para gestores que precisam tomar essa decisão com clareza. Você não precisa saber programar para entender o que está aqui. Mas vai sair sabendo exatamente o que perguntar para o time técnico ou para o fornecedor que está tentando te vender uma solução.

O que são modelos de linguagem e por que a distinção LLM vs SLM importa para empresas

Modelo de linguagem é, na prática, um sistema de IA treinado em enormes volumes de texto para entender e gerar linguagem. Quando você digita uma pergunta no ChatGPT e recebe uma resposta coerente, está interagindo com um LLM, que é a sigla para Large Language Model, ou modelo de linguagem grande.

O problema é que "grande" tem um custo. Modelos com centenas de bilhões de parâmetros exigem infraestrutura pesada, consomem energia significativa, e dependem de servidores na nuvem de terceiros. Para muitas empresas, isso é aceitável. Para outras, especialmente as que lidam com dados sensíveis ou têm restrições de conectividade, isso é um obstáculo real.

É aí que entram os SLMs, os Small Language Models. São modelos com arquitetura mais enxuta, geralmente entre 1 e 14 bilhões de parâmetros, que conseguem rodar em hardware local, laptops corporativos modernos ou servidores modestos. A troca é clara: um SLM bem treinado para uma tarefa específica supera um LLM genérico naquela mesma tarefa, com uma fração do custo operacional.

Pense assim: um LLM é como contratar um consultor generalista de alto nível, capaz de discutir qualquer assunto com profundidade. Um SLM bem calibrado é como ter um especialista interno que conhece o vocabulário da sua empresa, os seus processos, e responde em segundos. Para triagem de e-mails, classificação de documentos ou respostas de atendimento, o especialista ganha.

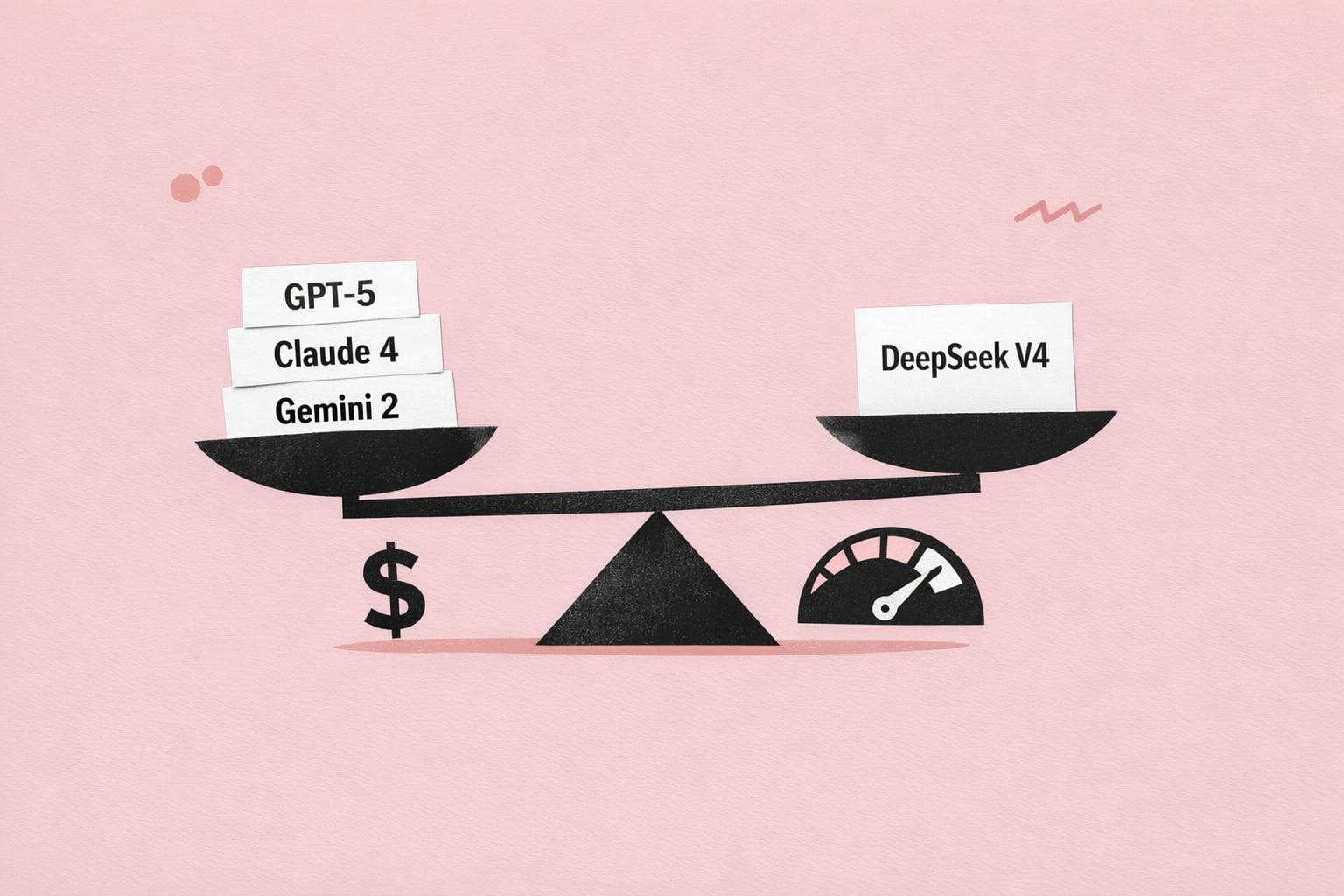

Os modelos frontier de 2026: GPT-5, Claude 4 e Gemini 2

Os chamados modelos frontier são os mais avançados disponíveis via API ou interface web. São os que mais aparecem na imprensa e, em geral, os mais caros por token de uso. Para empresas que precisam de raciocínio complexo, geração de conteúdo sofisticado ou análise de documentos extensos, eles ainda são a referência.

Veja um panorama de cada um, com lente de negócios:

O GPT-5 representa um salto considerável em capacidade de raciocínio em múltiplas etapas e contexto de longa duração. A OpenAI, que em 2026 captou mais de US$ 100 bilhões em investimentos, tem direcionado o produto para o mercado corporativo com o tier ChatGPT Enterprise, que inclui dados sem retenção para treinamento e acesso à API com volumes maiores. Para empresas que já usam o ecossistema Microsoft (Azure, Copilot, Office 365), a integração com GPT-5 é um caminho natural.

A Anthropic construiu o Claude com foco em segurança e previsibilidade de comportamento, dois atributos que importam muito para compliance corporativo. O Claude 4 se destaca em tarefas que exigem seguir instruções complexas sem improvisar, o que é crítico quando você está automatizando processos de negócio onde um desvio pode causar dano real. É frequentemente adotado em empresas de serviços financeiros e saúde que buscam respostas consistentes e auditáveis, devido ao foco da Anthropic em segurança e previsibilidade.

Gemini 2 (Google)

O Gemini 2 da Google tem integração nativa com o ecossistema de produtividade do Google Workspace, o que facilita muito a adoção para empresas que já rodam em Gmail, Docs e Drive. O modelo multimodal da Google processa texto, imagem e dados estruturados de forma integrada, o que abre casos de uso em análise de relatórios com gráficos e suporte visual.

Para um comparativo mais detalhado entre os três no dia a dia corporativo, veja o comparativo detalhado entre ChatGPT, Claude e Gemini.

Os modelos eficientes que estão ganhando espaço corporativo

Nem toda tarefa corporativa precisa de um modelo frontier. E quanto mais você entender isso, mais dinheiro e tempo você vai economizar.

Phi-3.5 (Microsoft)

Com aproximadamente 3,8 bilhões de parâmetros, o Phi-3.5 Mini suporta janela de contexto de 128 mil tokens, conforme documentação oficial da Microsoft, o que significa que ele consegue processar documentos longos inteiros em uma única chamada. É multilíngue com desempenho sólido em português, e roda em hardware local sem GPU de alto custo. Para empresas que precisam resumir contratos, extrair informações de PDFs longos ou classificar documentos internos, o Phi-3.5 é uma das escolhas mais inteligentes disponíveis.

Mistral NeMo 12B

O Mistral Nemo se posiciona como um modelo de aproximadamente 12 bilhões de parâmetros que compete com modelos significativamente maiores em tarefas de processamento de linguagem natural complexas, como tradução técnica, diálogos em tempo real e extração de entidades. É open source, o que significa que você pode baixar, ajustar com seus próprios dados, e rodar sem pagar por API externa. Para empresas com dados sensíveis, isso é uma vantagem estratégica real.

Qwen2 (Alibaba)

O Qwen2 vem em múltiplos tamanhos, de 0,5 a 72 bilhões de parâmetros, o que permite escalar a solução conforme o caso de uso. É open source e tem desempenho competitivo em português brasileiro, o que o torna relevante para empresas brasileiras que querem soluções locais sem depender de APIs estrangeiras.

DeepSeek R1/V3

O DeepSeek surgiu como uma alternativa competitiva desenvolvida com arquitetura diferente dos modelos ocidentais. O que chama atenção no contexto corporativo é a relação entre desempenho e custo de inferência, especialmente para empresas que processam grandes volumes de texto de forma rotineira. Para entender melhor o posicionamento técnico do modelo, leia nosso artigo sobre o DeepSeek V4.

Como escolher o modelo certo para a sua empresa

A pergunta certa não é "qual é o melhor modelo?" A pergunta certa é: "qual modelo atende o meu caso de uso, dentro do meu orçamento, com o nível de privacidade que preciso?"

Existe uma estrutura de quatro variáveis que ajuda a organizar essa decisão:

1. Complexidade da tarefa

Tarefas simples e repetitivas: classificação de e-mails, triagem de tickets, geração de respostas padronizadas. Para isso, um SLM bem configurado resolve com custo baixo e latência menor. Tarefas complexas e criativas: análise jurídica, produção de conteúdo estratégico, síntese de pesquisa de mercado. Para isso, modelos frontier como GPT-5 ou Claude 4 entregam mais valor.

2. Sensibilidade dos dados

Se você vai passar dados de clientes, contratos, informações financeiras ou saúde pelo modelo, rodar via API de terceiros significa que esses dados transitam por infraestrutura externa. Isso pode conflitar com LGPD, políticas internas ou contratos com clientes. Nesses casos, modelos open source rodando localmente eliminam o risco de vazamento e simplificam o compliance.

3. Volume e custo

Modelos frontier cobram por token. Para volumes baixos, o custo é irrelevante. Para volumes altos, como uma empresa que processa mil atendimentos por dia, a diferença entre usar um modelo frontier via API e rodar um modelo open source localmente pode representar uma economia significativa por ano, dependendo do volume processado.

4. Integração com sistemas existentes

Se sua empresa já usa Azure, a integração com modelos OpenAI via Azure AI é mais simples. Se usa Google Workspace, Gemini se integra com menos fricção. Se tem time técnico capaz de fazer deploy local, modelos open source abrem mais possibilidades. A escolha tecnicamente superior que não integra com o que você já usa vai criar problemas operacionais que consomem mais do que o ganho de performance.

Para ajudar a visualizar, veja a tabela abaixo com os principais modelos organizados por perfil de uso:

| Modelo | Tipo | Melhor para | Privacidade de dados | Custo relativo |

|---|---|---|---|---|

| GPT-5 | LLM frontier | Raciocínio complexo, conteúdo estratégico | API externa | Alto |

| Claude 4 | LLM frontier | Compliance, seguir instruções precisas | API externa | Alto |

| Gemini 2 | LLM frontier | Integração Google Workspace, multimodal | API externa | Alto |

| DeepSeek V4 | LLM frontier | Volume alto, custo de inferência | API externa / local | Médio |

| Mistral Nemo 12B | SLM open source | NLP complexo, dados sensíveis, local | Local | Baixo |

| Phi-3.5 | SLM | Documentos longos, multilíngue, local | Local | Baixo |

| Qwen2 | SLM open source | Escalabilidade, múltiplos tamanhos | Local | Baixo |

Usando modelos de linguagem em português: o que funciona e o que trava

Português merece atenção especial porque não é uma língua de segunda classe no treinamento dos modelos grandes, mas tampouco recebe o mesmo volume de dados que inglês. Os modelos frontier têm desempenho muito bom em português brasileiro para tarefas gerais. O problema aparece em nuances regionais, jargões de setor e documentos com formatação específica do mercado brasileiro, como contratos e laudos.

Algumas práticas que fazem diferença:

Seja explícito no prompt sobre o dialeto e o tom. "Escreva em português brasileiro, linguagem formal, para um público executivo" produz resultados significativamente melhores do que simplesmente escrever o pedido em português. Modelos como Phi-3.5 e Mistral Nemo têm suporte multilíngue declarado com bom desempenho em PT-BR, o que os torna opções concretas para empresas brasileiras.

Para comunicação interna, um padrão de prompt que funciona bem é: objetivo claro + contexto + tom + restrições. Por exemplo: "Resuma este relatório de vendas em três parágrafos para o board, linguagem direta, sem jargões técnicos, destacando o número mais relevante." Esse tipo de estrutura reduz retrabalho e aumenta consistência nas entregas.

A integração com ferramentas de CRM, sistemas de atendimento e editores de documento exige atenção ao encoding e ao formato de saída do modelo. Verifique se o modelo retorna texto limpo ou se adiciona formatação markdown que o sistema receptor não interpreta corretamente.

O que esperar dos próximos meses: tendências que afetam decisões de agora

Algumas tendências que já estão moldando o mercado corporativo de modelos de linguagem em 2026 e que devem influenciar suas decisões de hoje:

Modelos especializados por setor estão chegando. Assim como existe o Phi-3.5 para documentos longos, o mercado está vendo surgir modelos ajustados para saúde, direito, finanças e varejo. Para empresas nesses setores, um modelo menor e especializado vai superar modelos gerais maiores nas tarefas do dia a dia.

Edge computing está mudando onde a IA roda. Modelos como OpenELM da Apple foram projetados para rodar diretamente no dispositivo, com baixíssima latência e sem conexão à internet. Para aplicações móveis, pontos de venda, e equipamentos industriais, isso abre um conjunto novo de casos de uso que simplesmente não eram viáveis com modelos na nuvem.

O custo de fine-tuning está caindo. Ajustar um modelo open source com dados da própria empresa, o que se chama de fine-tuning, ficou acessível para equipes técnicas modestas. Uma empresa com quantidade suficiente de exemplos de atendimento bem anotados pode realizar fine-tuning de modelos como o Mistral NeMo para adaptar tom e vocabulário da marca, conhece os produtos e evita os erros comuns de um modelo genérico.

Avaliação começa a ser tratada como processo, não evento. As empresas que estão tendo mais sucesso com IA não escolhem um modelo e ficam com ele para sempre. Elas constroem benchmarks internos com exemplos reais das suas tarefas, testam modelos novos contra esses benchmarks regularmente, e trocam quando a equação de custo-benefício muda.

Conclusão

O ecossistema de modelos de linguagem para empresas ficou complexo rápido demais. Mas a complexidade esconde uma lógica simples: tarefas complexas e criativas pedem modelos frontier, tarefas repetitivas e estruturadas pedem modelos eficientes, e dados sensíveis pedem modelos locais.

O movimento mais inteligente que um gestor pode fazer agora é parar de perguntar "qual é o melhor modelo" e começar a mapear os três ou quatro casos de uso de maior impacto no seu negócio. Com esses casos de uso em mãos, a escolha do modelo vira uma decisão técnica simples, não uma aposta.

Se você ainda está estruturando como levar IA para dentro da empresa de forma sistemática, leia o guia completo de implementação de IA na empresa. E se quiser entender como transformar adoção em retorno mensurável, veja também como calcular o ROI de IA na sua empresa.