TL;DR: O DeepSeek V4 é um modelo de 1 trilhão de parâmetros, multimodal nativo (texto, imagem e vídeo) e deve ser lançado como open-weight, o que significa que qualquer empresa poderá rodá-lo sem pagar por API. Benchmarks vazados apontam desempenho de topo em coding. Ele também funciona em chips chineses, sem dependência de Nvidia. Se os números se confirmarem, é um divisor de águas para quem paga caro por modelos proprietários. Ainda não foi lançado oficialmente, então cautela antes de mudar qualquer decisão de stack.

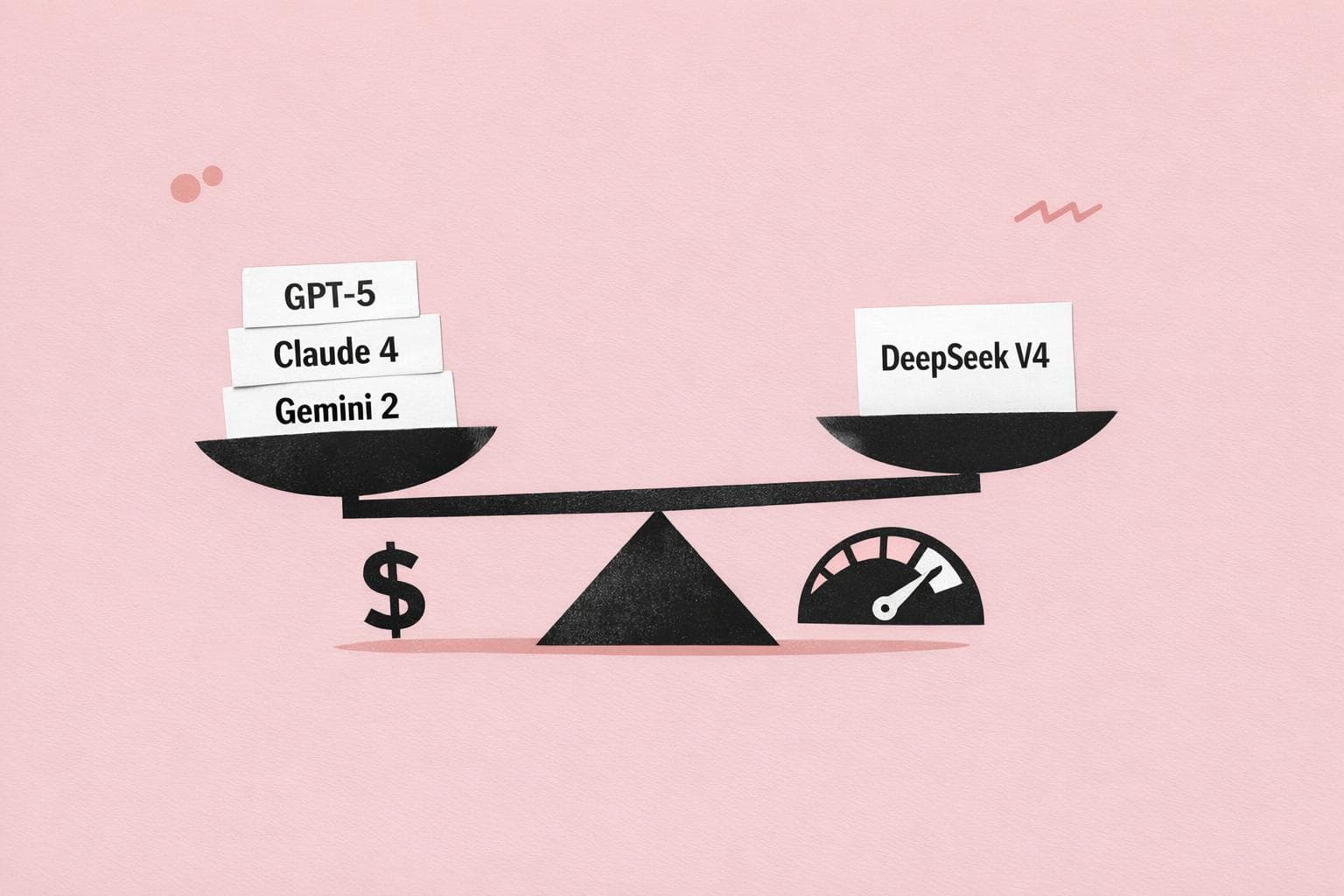

O modelo de IA mais aguardado de 2026 pode ser lançado a qualquer momento. E ele não vem da OpenAI, do Google, nem da Anthropic.

Segundo o TechNode e o Financial Times, o DeepSeek V4 estava previsto para ser lançado ainda na semana de 3 de março, embora múltiplas janelas de lançamento já tenham passado sem confirmação oficial. A empresa chinesa segue em silêncio, mas fontes próximas ao desenvolvimento indicam que o modelo está em estágio final antes de vir a público.

O que chama atenção não é só o tamanho do modelo. É o que ele representa para qualquer empresa que hoje paga por acesso a modelos fechados e caros.

O que é o DeepSeek V4 e por que é diferente dos anteriores

O V4 é um modelo MoE, sigla para Mixture-of-Experts. Na prática, isso significa que, apesar de ter 1 trilhão de parâmetros no total, ele ativa apenas uma fração desses parâmetros para cada tarefa. O resultado é um modelo enormemente capaz, mas muito mais eficiente computacionalmente do que o número bruto de parâmetros sugere.

Não é a primeira vez que o DeepSeek usa essa arquitetura. O V3 e o R1, lançados no início de 2025, já eram MoE e geraram repercussão global justamente por terem desempenho próximo ao dos modelos da OpenAI a uma fração do custo de treinamento. O V4 segue a mesma lógica, mas em escala muito maior e com um diferencial novo: é nativo multimodal.

Isso quer dizer que o modelo foi treinado do zero para entender e gerar texto, imagem e vídeo de forma integrada, não como uma adição posterior. A janela de contexto de 1 milhão de tokens também é notável: permite processar documentos longos, bases de código extensas, ou horas de transcrição de vídeo em uma única chamada.

Conforme reportado pelo TechNode, benchmarks vazados apontam desempenho de ponta em tarefas de coding. Outros domínios ainda aguardam confirmação com os resultados oficiais.

O detalhe que muda a equação de hardware

Há um ponto nesta história que recebe menos atenção do que merece: o DeepSeek V4 foi otimizado para chips chineses da Huawei e da Cambricon, não para GPUs da Nvidia.

Isso importa por dois motivos práticos. Primeiro, porque chips Nvidia de alta performance continuam sendo recurso escasso e caro, especialmente para empresas fora dos grandes centros de cloud. Segundo, porque demonstra que é possível treinar e rodar modelos de ponta sem depender do hardware que, até agora, era praticamente obrigatório.

Para a maioria das empresas brasileiras, isso não significa sair comprando chips Huawei. Significa que, quando o modelo for disponibilizado como open-weight, provedores de cloud que usam infraestrutura alternativa poderão oferecer acesso a ele com custo menor. A dependência da arquitetura Nvidia começa a ser questionada em escala.

O impacto direto para founders e donos de empresa

Vamos ser diretos sobre o que muda se o V4 entregar o que os vazamentos sugerem.

Hoje, uma empresa que usa modelos de ponta para automação, análise de documentos, ou geração de conteúdo paga mensalmente por APIs de empresas como OpenAI ou Anthropic. Esses valores variam, mas para uso intensivo chegam facilmente a milhares de dólares por mês. Com um modelo open-weight de desempenho equivalente, essa empresa pode rodar o modelo em infraestrutura própria ou em provedores de cloud independentes, cortando o custo de forma significativa.

O V3, lançado em 2025, já havia provocado esse movimento. Diversas empresas que acompanhamos migraram partes do seu stack para o V3 exatamente por esse motivo. O V4, sendo multimodal e com janela de contexto de 1 milhão de tokens, amplia esse cenário para casos de uso que antes exigiam modelos como o GPT-4o ou o Gemini Ultra. Para quem está mapeando seu stack de IA agora, vale checar também as ferramentas de IA agêntica para empresas que já estão sendo construídas sobre modelos open-weight.

Um ponto de atenção: rodar um modelo de 1 trilhão de parâmetros, mesmo com arquitetura MoE, ainda exige infraestrutura robusta. Não é algo que roda no notebook de ninguém. Para pequenas empresas, a alternativa mais realista será acessar o V4 via APIs de terceiros que hospedem o modelo, não rodá-lo internamente. O benefício ainda existe, mas a trajetória é diferente.

O que ainda não sabemos

Apesar dos detalhes circulando em fontes como TechNode, Financial Times, PYMNTS e leaveit2ai.com, há lacunas importantes.

Os benchmarks vazados cobrem principalmente coding. Não há dados confirmados sobre raciocínio geral, desempenho em português, ou capacidades multimodais específicas. O histórico do DeepSeek sugere que os resultados serão bons, mas histórico não é garantia.

Também não há confirmação sobre os termos exatos da licença open-weight. O V3 e o R1 foram lançados com licenças relativamente permissivas para uso comercial, mas com algumas restrições. O V4 pode seguir o mesmo caminho ou ter condições diferentes. Isso afeta diretamente quem planeja incorporá-lo em produto.

Por fim, múltiplas janelas de lançamento já foram perdidas sem explicação, segundo as mesmas fontes. O modelo pode estar mais próximo ou mais distante do que as reportagens sugerem.

Conclusão

O DeepSeek V4 representa a continuação de uma tendência clara: modelos de ponta estão ficando acessíveis fora do ecossistema de modelos fechados e caros. Se os benchmarks se confirmarem, qualquer empresa que hoje paga por acesso a modelos proprietários terá uma alternativa concreta para pelo menos parte do seu stack.

O que você deve fazer agora: não mude nada ainda. Aguarde o lançamento oficial e os benchmarks independentes. Mas coloque o V4 no radar do seu planejamento de stack de IA para o segundo trimestre de 2026. Quando sair, a janela para testar e comparar com o que você usa hoje valerá o tempo investido.

Se você ainda está estruturando como a IA vai funcionar na sua empresa, o guia completo de implementação de IA na empresa é um bom ponto de partida enquanto o V4 não chega.